Anthropic presenta

Claude 3.5: Un potente modelo de IA con herramientas colaborativas

Claude supuestamente supera a ChatGPT de OpenAI en habilidades de codificación y razonamiento

Anthropic, una compañía líder en investigación de IA, ha anunciado el lanzamiento de Claude 3.5 Sonnet, su modelo de IA más reciente. Esta iteración, según afirman, supera a los modelos anteriores de Claude y al recientemente lanzado GPT-4 Omni de OpenAI en varias áreas clave. Además, Anthropic presentó Artifacts, un espacio de trabajo dentro de Claude que permite a los usuarios editar y desarrollar proyectos generados por IA.

"No apuntamos a mejoras incrementales", dijo el director ejecutivo de Anthropic, Dario Amodei. "Nuestra visión es que la IA colabore de manera significativa con las personas y el software. Artifacts es un experimento inicial en esta dirección".

Esto marca el primer lanzamiento de la familia Claude 3.5, siguiendo el lanzamiento de Claude 3 hace solo tres meses. Anthropic reconoce el panorama competitivo y destaca los planes para lanzar versiones 3.5 de sus modelos de nivel básico (Haiku) y de gama alta (Opus) a finales de este año. También están explorando características como la búsqueda web y la integración de memoria para futuras iteraciones.

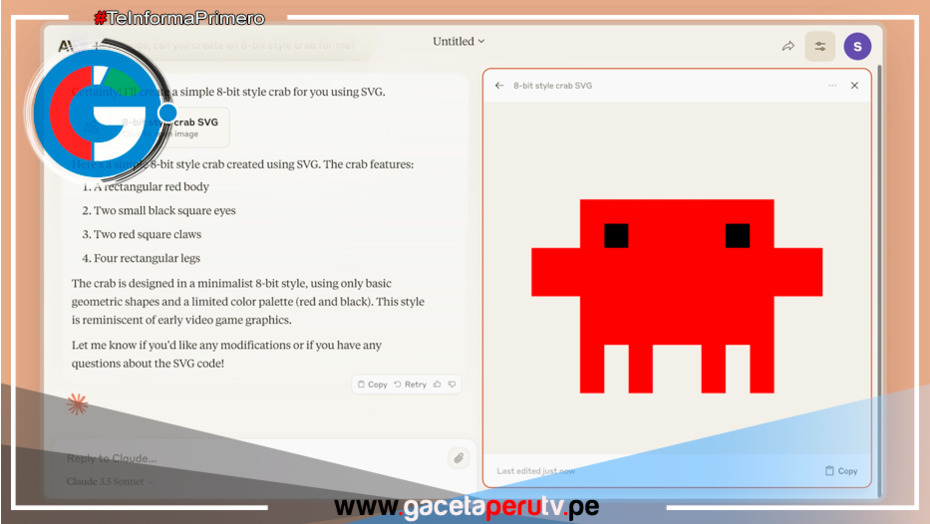

Claude 3.5 va más allá de la simple potencia bruta, ofreciendo nuevas funcionalidades a través de Artifacts. Los usuarios ahora pueden crear proyectos interactivos dentro de Claude. Anthropic mostró la creación de personajes e íconos para un videojuego de cangrejos de 8 bits generado por IA, demostrando las capacidades de edición interactiva.

Anthropic presume que Claude 3.5 Sonnet es su modelo de visión más sólido hasta ahora, lo que se traduce en un razonamiento visual superior, interpretación de gráficos y extracción de texto de imágenes imperfectas. Afirman que supera a GPT-4 Omni en varias tareas de visión, particularmente en la comprensión visual de gráficos, documentos y matemáticas.

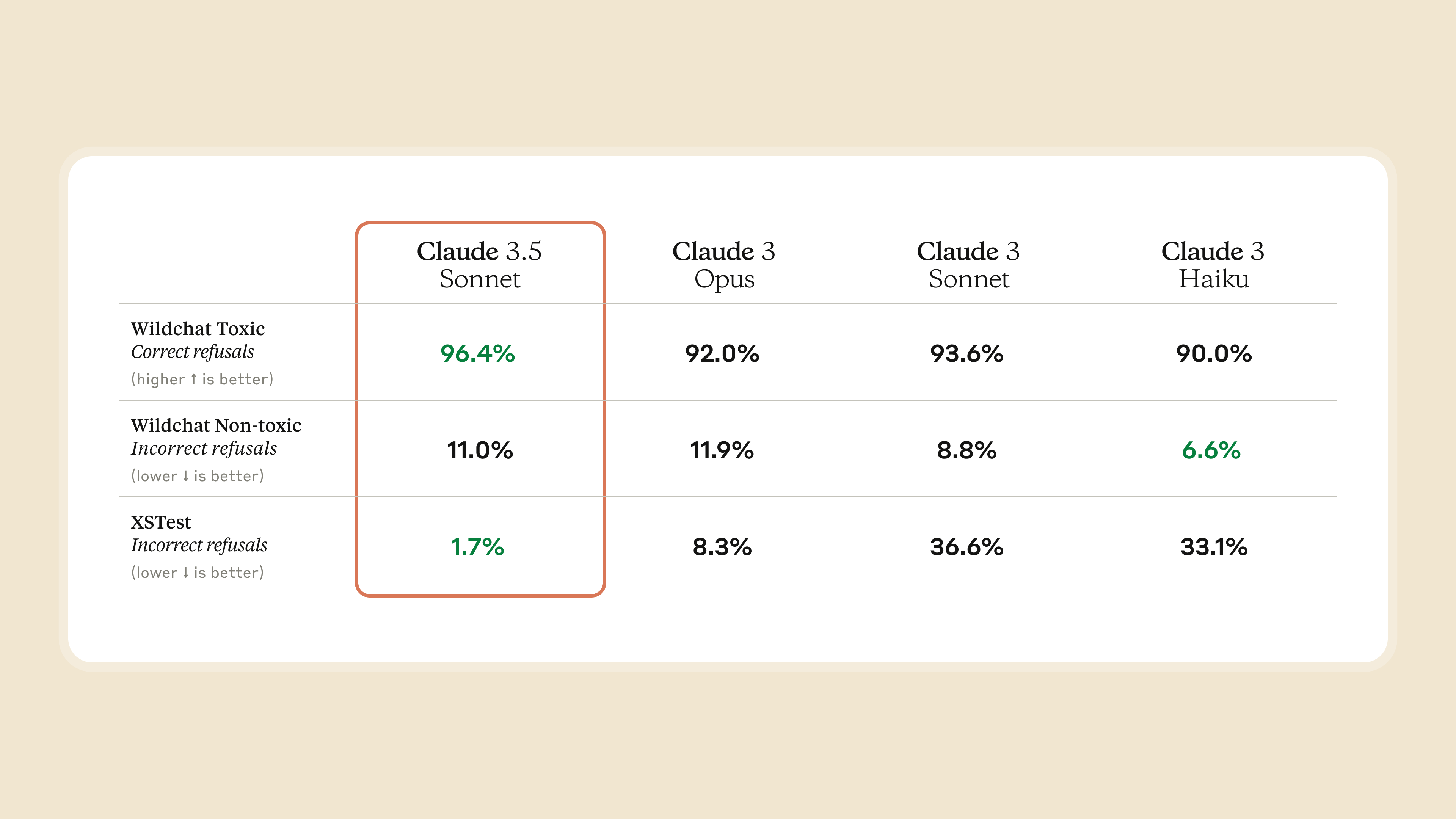

Una mejora crucial destacada por Anthropic es la capacidad de Claude 3.5 para discernir respuestas apropiadas. Los chatbots de IA a menudo son criticados por negarse a responder ciertas preguntas. Habiendo abordado este problema con Claude 3.5, Anthropic expresa confianza en su juicio al encontrarse con consultas potencialmente dañinas o inapropiadas.

Fuente: Gizmodo

Suscríbete a nuestro Newsletter

Recibe nuestro Newsletter diariamente registrándote con tu email y mantente informado con las noticias más relevantes del día.

También te puede interesar

Mas articulos

Más leídas - TECNOLOGÍA